Popol Post

🤖 L'IA, une intelligence pas si artificielle...

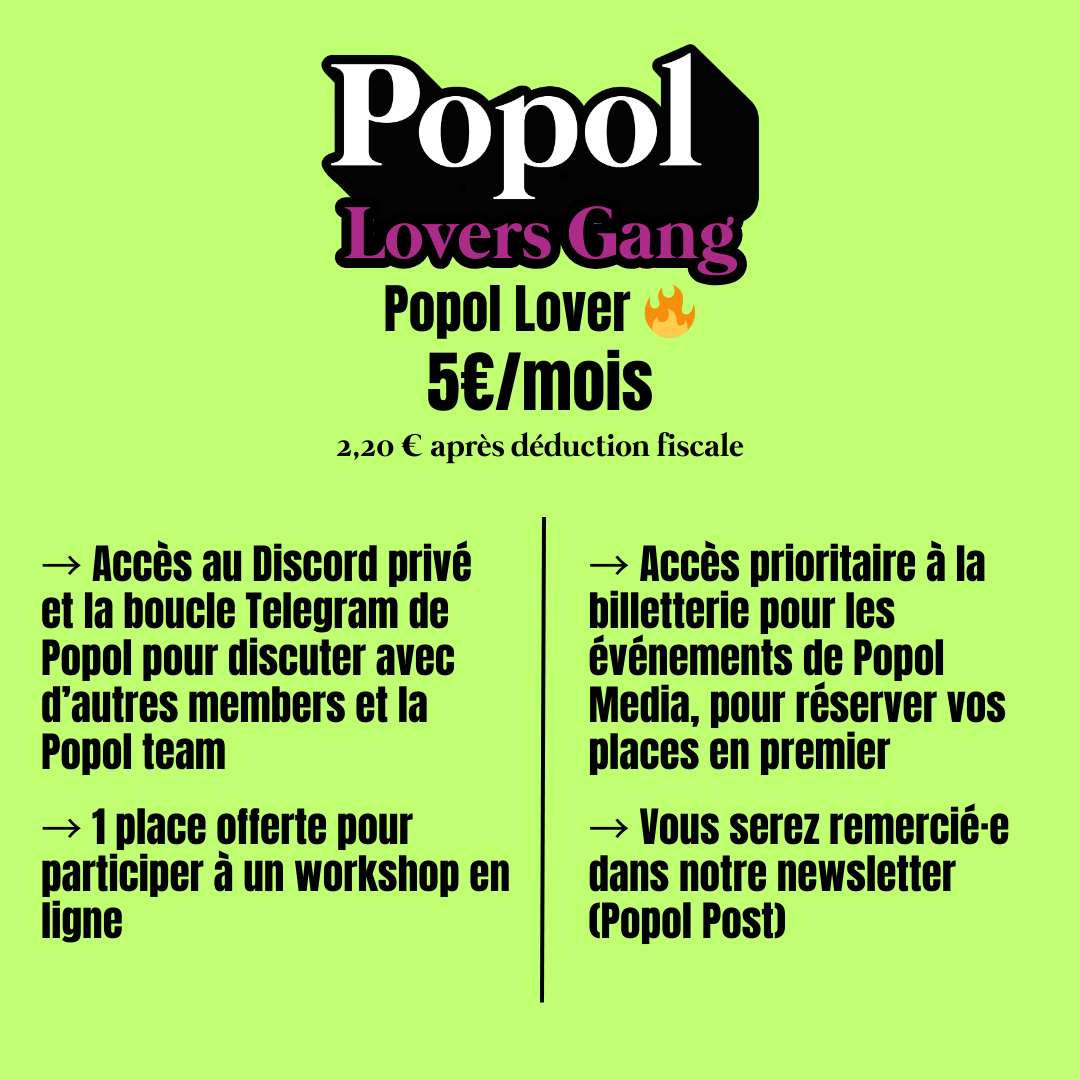

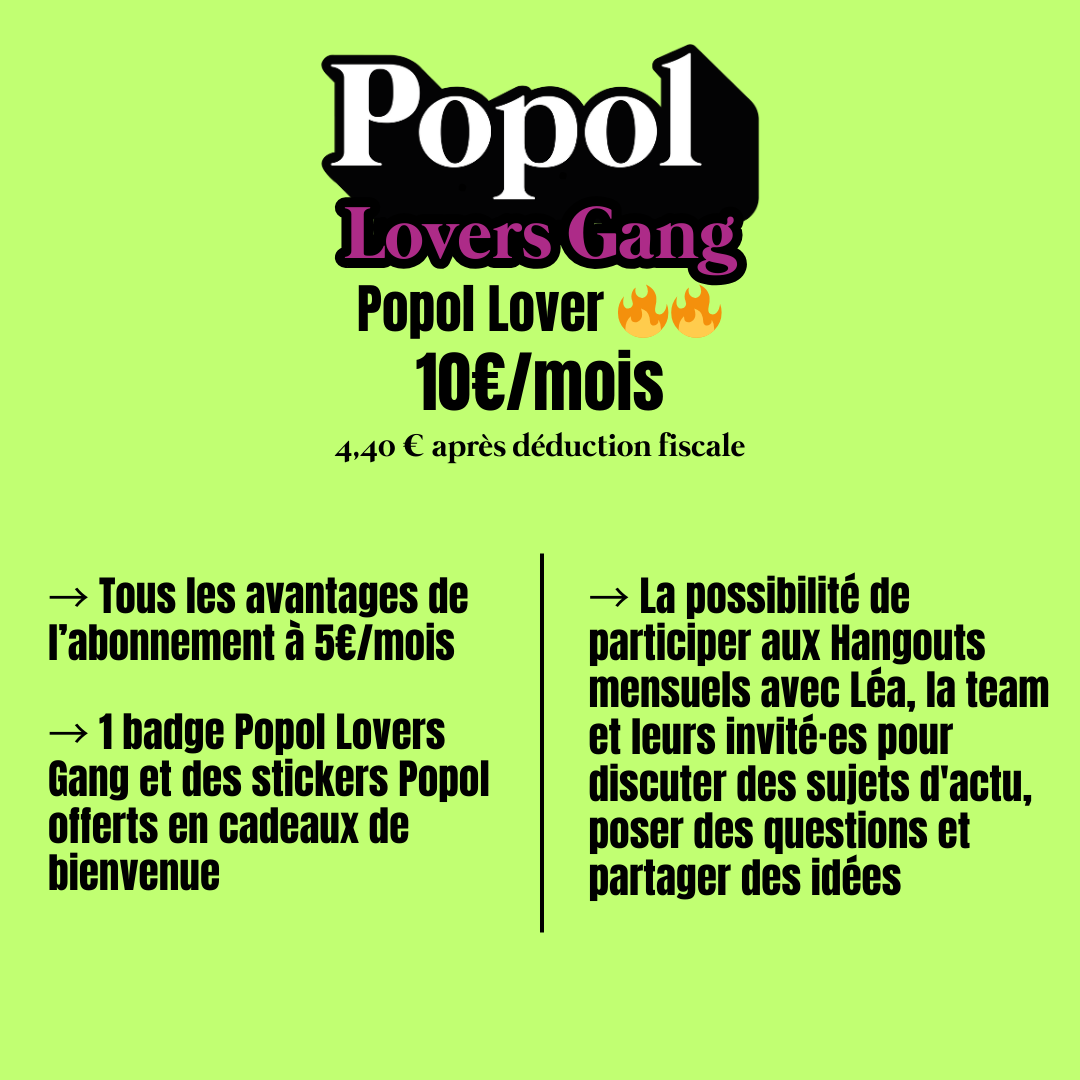

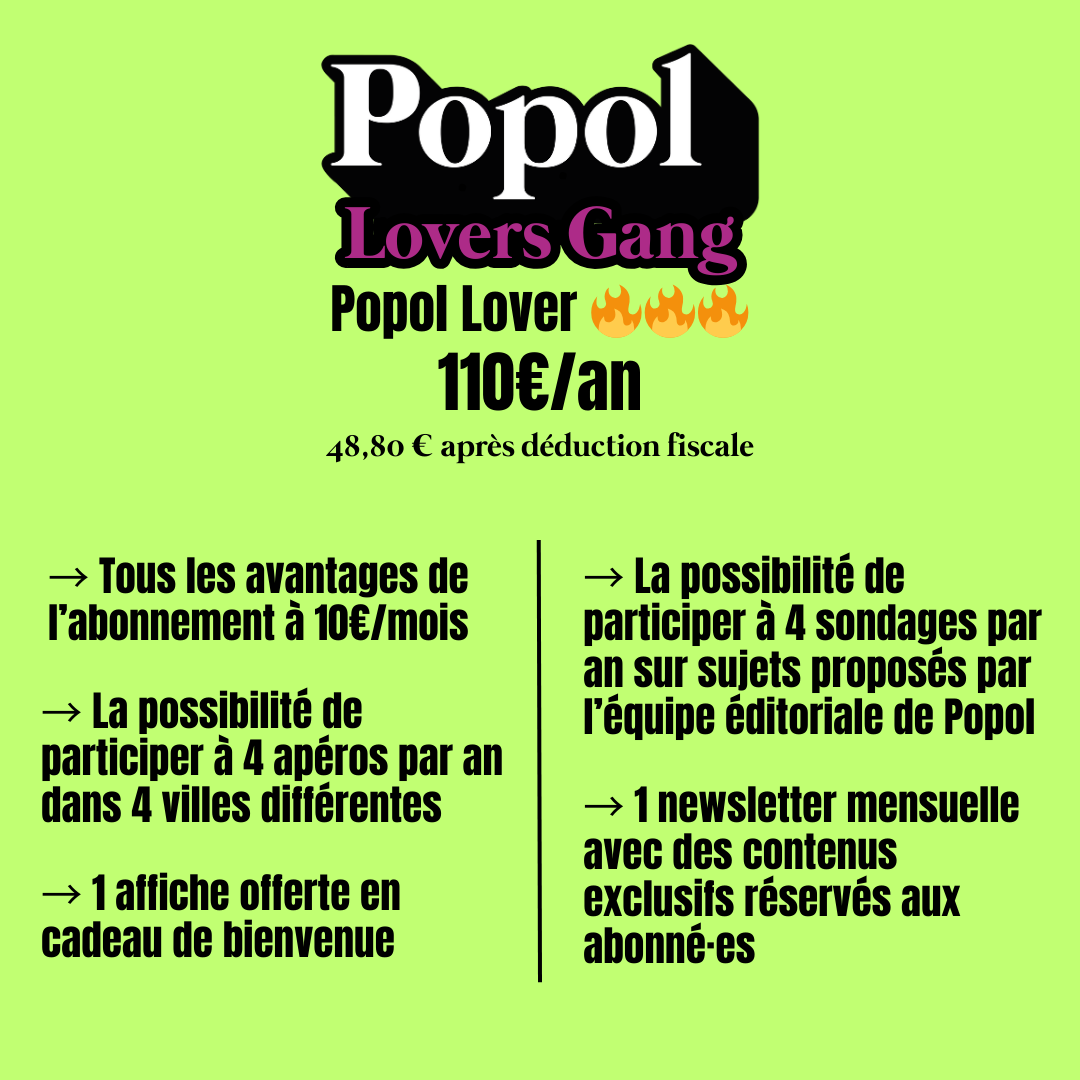

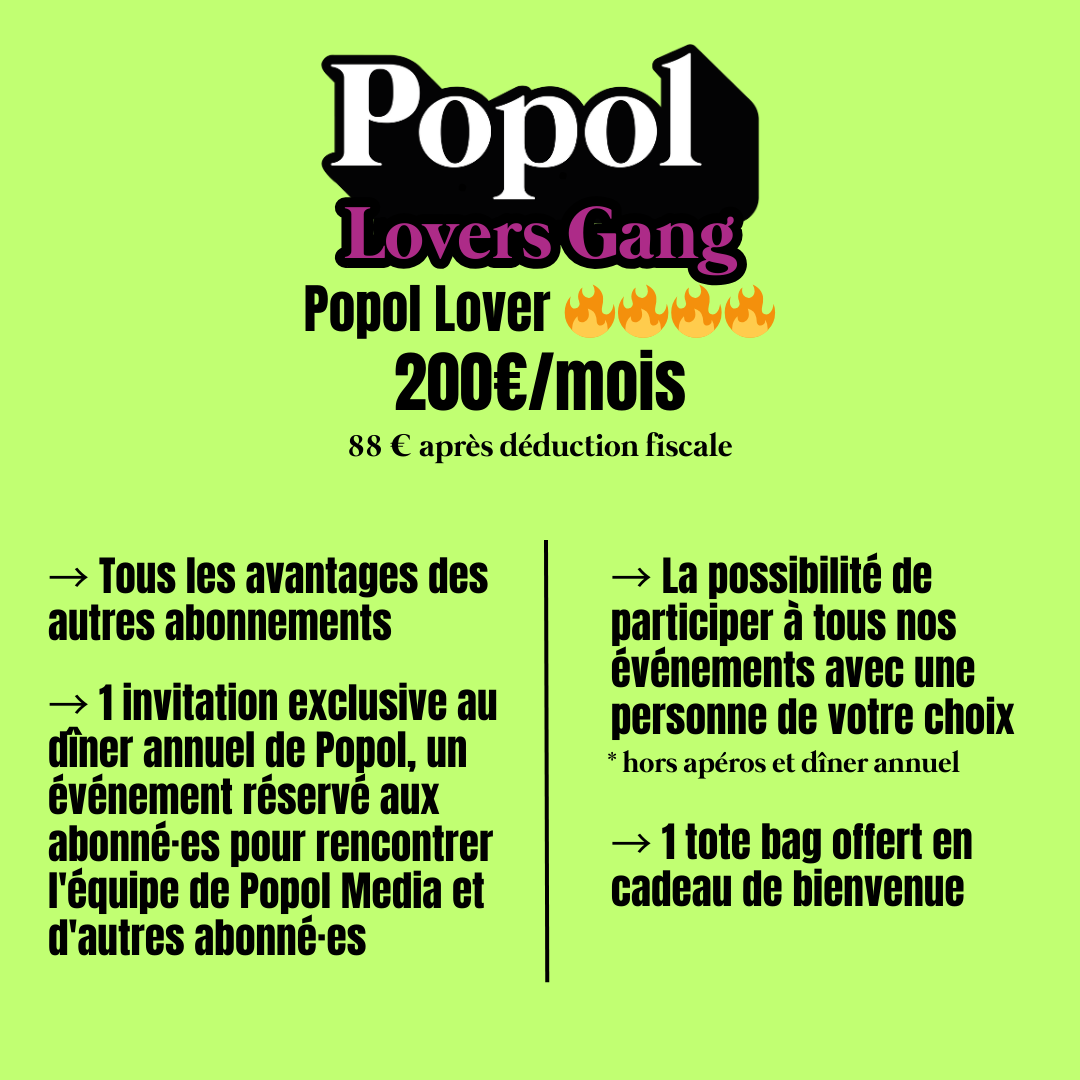

Devenez membre du Popol Lovers Gang !

Cela vous permet de financer et de soutenir la production des contenus de Popol Media (4 podcasts, 2 newsletters et une 20aine d’articles par mois) et de bénéficier de moments et contenus exclusifs !

L’IA, les femmes & la politique

La défaite de Kamala Harris et la victoire de Donald Trump lors de la dernière élection présidentielle aux États-Unis est riche d’enseignements et s’il y a une leçon que l’on peut tirer de la campagne qui a précédé l'élection, c'est la suivante : l’intelligence artificielle (IA) bénéficie rarement aux femmes politiques.

L’intelligence artificielle est définie par le dictionnaire Larousse dans les termes suivants : “Ensemble de théories et de techniques mises en œuvre en vue de réaliser des machines capables de simuler l'intelligence humaine”. Ainsi, cette locution englobe de nombreux exemples comme les outils bien connus que sont ChatGPT, les deepfakes ou encore les algorithmes de recommandations qui gouvernent les réseaux sociaux.

Même s’il est difficile de mesurer précisément l’impact de l’IA dans les urnes, le rôle qu’elle a joué en faveur de Donald Trump pendant la campagne présidentielle étatsunienne est indéniable. Outre les tweets et autres communications de désinformation visant Kamala Harris, la candidate démocrate a également été victime de deepfakes visant à la moquer, l’humilier et la décrédibiliser.

Et si cette intelligence artificielle au service de Trump a pu aussi bien prospérer en ligne, c’est notamment parce que l’environnement des réseaux sociaux est particulièrement perméable à la misogynie et à la désinformation orchestrée par l’extrême droite.

De nombreuses études ont par ailleurs démontré que les femmes politiques font l’objet d’un traitement d’une violence inouïe en ligne, comme le soulignent Lucina Di Meco et Saskia Brechenmacher : “Les femmes semblent être ciblées de manière disproportionnée par les abus en ligne et les attaques de désinformation. Cette tendance est encore plus prononcée pour les dirigeantes politiques appartenant à des groupes minorisés ; pour celles qui sont très visibles dans les médias ; et pour celles qui s’expriment sur les questions féministes.”

Mais alors, la faute à qui ? La faute à l’IA ? On peut légitimement se poser la question, notamment lorsque l’on constate que c’est sur X (ex-Twitter) que Kamala Harris a le plus été attaquée, et comme vous le savez probablement déjà, l’algorithme de recommandation sur X depuis le rachat de la plateforme par Elon Musk a cette fâcheuse tendance à davantage promouvoir les contenus d’extrême droite. Et là encore on ne vous apprend rien, mais Elon Musk a massivement investi dans la campagne de Donald Trump pour qu’il remporte l’élection présidentielle. Nos milliardaires à nous investissent dans les médias et aux US ils investissent aussi dans les réseaux sociaux…

De manière générale, le rôle joué par les plateformes a souvent été pointé du doigt dans de nombreuses campagnes politiques. C’est précisément ce qu’a révélé le scandale de Cambridge Analytica. De son côté, Amnesty international a révélé dans un rapport publié en 2022 que “Les dangereux algorithmes de Meta, qui détient Facebook, ainsi que la recherche effrénée du profit ont considérablement contribué aux atrocités perpétrées par l’armée myanmar contre le peuple rohingya en 2017”.

L’IA peut être tenue pour responsable de nombreuses choses, mais n’oublions pas que derrière l’IA il y a des humains qui la conçoivent, qui l’entraînent et qui la régulent. Sans compter que l’IA, et les nouvelles technologies de manière générale, peuvent représenter une chance inouïe pour les innovations démocratiques et pour faire émerger des profils politiques non médiatiques. Les nouvelles technologies peuvent aussi être des outils très utiles pour les féministes comme le souligne le Council on Foreign Relations : “faire partie d'une communauté mondiale en ligne a aidé des militantes à se rassembler contre des gouvernements répressifs, à sensibiliser aux injustices et à dénoncer les violences sexuelles et sexistes à travers des mouvements mondiaux comme #MeToo, #NiUnaMenos et la Women’s March”.

Ainsi, il ne faut pas peut-être déserter la toile au risque de se priver d’outils d’organisation et de mobilisation sociale et politique. C’est précisément pour cela que les fondatrices de #ShePersisted, (une association spécialisée dans les recherches autour des menaces numériques ciblant les femmes politiques), Kristina Wilfore et Lucina Di Meco, se sont donné pour mission d’aider les femmes politiques à “renforcer leur résilience numérique”.

Elles appellent aussi à la mise en place d’une régulation des réseaux sociaux afin de protéger les électeurices de la désinformation et de permettre aux femmes d’avoir les mêmes chances que les hommes d’accéder aux responsabilités politiques car pour elles “la prolifération non réglementée de contenus politiques sur les réseaux sociaux et l’IA pourrait devenir une menace pour le processus électoral américain – ainsi que pour la parité politique aux États-Unis”.

Donc tout n’est peut-être pas à jeter, mais il faut changer l’IA pour reprendre le pouvoir et en faire un outil utile à nos luttes tout en cherchant à en limiter les menaces pour notre démocratie. Et on peut même aller encore plus loin en se demandant comment le féminisme pourrait transformer l’IA au service de la démocratie ?

L’IA : Plus que belle !

À première vue, Aitana Lopez est une influenceuse comme il y en a des milliers sur la toile. Sur son compte @fit_aitana, suivi par plus de 330 000 personnes, la belle blonde aux cheveux teints en rose poste des photos de ses nouvelles tenues, “Currently in love with my cheetah print”, de ses séances de fitness, du dernier café à la mode barcelonais (la belle est espagnole) et, bien sûr de ses vacances. Comme nombre de ses consœurs, elle s’adonne au placement de produit et à la collaboration commerciale avec des marques telles que Nike. Sauf que vous ne croiserez jamais Aitana Lopez en train de faire son running le long de la plage de Barcelone, pas plus que dans une boîte de nuit, car Aitana n’existe pas. Elle est générée par l’IA. Elle est l’une des mannequins artificiels de l’agence The Clueless, fondée par Ruben Cruz.

Dans le même ordre d’idée, Deanna Ritter (55 000 followers) a participé le 10 mai dernier au premier concours de beauté “Miss IA” en compagnie de tout un tas de compétitrices toutes aussi fausses qu’elle.

Ces anecdotes ont beau être « amusantes », elles ne parviennent toutefois pas à masquer les problèmes éthiques que posent ces nouvelles « influenceuses » puisqu’en effet, le passage par l’IA ne fait qu’accentuer des stéréotypes et des critères de beautés non seulement étouffants et irréalistes mais aussi racistes, grossophobes et validistes. Les compétitrices de Deanna Ritter étant, comme de juste, de grandes blondes, à tailles fines et jambes interminables.

Notre rapport à la beauté est un sujet vieux comme le monde. Qui voit ? Qui décide de ce qui est beau ou pas ? Comme les critères évoluent-ils au fil des époques ? Et le recours à l’intelligence artificielle dans la photographie, notamment publicitaire, réactive ces questions-là ?

Car l’Intelligence artificielle ne génère que ce que l’on veut bien lui faire générer et ne fait donc que reproduire des pesanteurs déjà présentes, et depuis bien longtemps, dans notre rapport à la beauté et à ce qu’elle peut bien signifier. Dans les images produites par l’IA, comme dans nos vies, comme dans les films et les séries, comme dans notre éducation, la femme belle est une femme blanche, souvent blonde, toujours mince.

Les risques, avec l’intelligence artificielle, c’est que les algorithmes arrivent à lisser tous les autres biais, puisqu’ils s’inspirent d’œuvres et de références culturelles, elles-mêmes marquées par des siècles de patriarcat. Et c’est un cercle vicieux, puisque plus l’IA génèrera de grandes blondes, plus les biais se rétréciront sur ces seuls canons de beauté.

Loin d’être une évolution technologique majeure, l’IA représente pour les femmes un gigantesque retour en arrière, à des canons de beauté irréalistes et rétrogrades, absolument pas en phase avec la vie telle qu’elle se déroule. Il devient urgent de contrer ces biais sexistes, en injectant dans l’IA d’autres critères, d’autres modèles.

“In bIAs we trust”

Les journaux américains sont clairs ; D. Trump a fait beaucoup d’effets d’annonce avant sa victoire et la mise en œuvre de ses déclarations sera plutôt chaotique. C’est le cas pour l’IA.

Lors de sa campagne, D. Trump a déclaré qu’il abrogerait le décret de Joe Biden soulignant la nécessité de veiller à ce que les modèles d'IA, formés à partir de données humaines, ne produisent pas de résultats discriminatoires. Selon Trump, ce décret « entrave l’innovation » en la matière.

Pour les expert·es, il faut maintenant se préparer à « un nouveau monde », celui où l'accent ne sera plus mis sur la régulation, mais sur les entreprises technologiques qui prendront leurs propres décisions en matière de sécurité. Les dirigeants d'entreprises d'IA s’accordent même aujourd’hui à dire que l’IA sera bientôt plus affutée que l’intelligence humaine.

Car les discriminations sont bien là. Nous les avions déjà relevées en ce qui concerne le genre.

Comme l’explique Benoît Raphael sans dernière newsletter : « les modèles de langage (LLM) comme ceux qui alimentent ChatGPT ne comprennent pas les textes comme nous. Ils utilisent des calculs mathématiques pour créer des liens entre les mots, sans saisir leur sens. » Les spécialistes appellent cela « l’hallucination ». En quelque sorte, les LLMs « rêvent » l’information pour prédire une réponse en fonction de ce dont on les nourrit ; ils ne vont pas la chercher dans une base de données. Depuis le 30 octobre, on sait d’ailleurs qu’aucun modèle n'atteint 50% de réponses correctes à ce jour. Pour Yann Le Cun, que le magazine Challenges qualifie de « rock star discrète de l’IA », les LLMs seront dépassés dans 5 ans. « Comment faisons-nous pour bâtir un système d’IA qui comprenne le monde réel, qui ait une mémoire persistante, qui peut raisonner et planifier. Ce sont 4 caractéristiques d’un comportement intelligent que les LLMs ne savent basiquement pas faire, ou qui ne peuvent le faire que d’une manière très superficielle et approximative ».

Exit donc les outils d’IA qui hallucinent. Le défi n’est plus de générer mais de planifier et raisonner. Est-on prêt·es à la fin de la vie privée, à vivre avec des IA qui nous connaissent mieux que nous-mêmes ?

Retrouvez l’article complet « IA : Intox Artificielle » en cliquant ici.

L’IA, nouvelle lutte écoféministe ?

L’intelligence artificielle (IA) est le nouvel eldorado des entreprises du numérique mais plus largement de toutes les couches industrielles ou servicielles. Elle est même considérée comme la quatrième révolution industrielle et une nouvelle forme de progrès disruptif. Les défenseurs de l’IA diront que grâce à celle-ci, de grosses économies d’énergies pourront être réalisées dans les bâtiments ou les usines avec la régulation des consommations, que le travail et l’accès à la connaissance seront facilités ou encore qu’elle sera une créatrice exponentielle de nouveaux emplois.

Cependant, ce discours ressemble fortement aux arguments capitalistes de l’industrialisation du début du XXème siècle ou à l’automatisation et à la mondialisation des années 80. Il est donc possible de nous interroger si le changement de la société par l’IA, ne serait pas tout simplement une reproduction de l’ancien monde et l’avènement d’un nouveau capitalisme blanc, dominant et extractiviste pour le XXIème siècle ?

En septembre 2024, l’Ademe (Agence Nationale de la Transition Ecologique) alerte sur les impacts environnementaux du numérique, des data centers et de l’IA. Celle-ci évalue que le numérique représente déjà 10% de la consommation d’électricité en France, une empreinte carbone qui pourrait tripler d’ici à 2050, 70 millions d’équipements (smartphones, téléviseurs) inutilisés, ni réparés, ni recyclés en France… Désormais bien documentés, les impacts environnementaux du numérique se révèlent de plus en plus importants. L’Ademe ajoute que « L’étude Hubblo a réalisé une évaluation des impacts environnementaux des centres de données à l’étranger hébergeant des données d’usages venant de France. Les principaux résultats de cette étude montrent que la part de l’empreinte carbone liée aux centres de données passerait de 16 % de l’empreinte carbone du numérique à 42 %. L’empreinte carbone de la France en 2030 passerait alors de 17 MtCO2 eq à 25 Mt Co2 eq ». Les data center GPU dédiées à l’IA nécessite six à neuf fois plus de puissance électrique qu’une « baie » de processeurs classiques (dédiés aux autres services fournis par les opérateurs de cloud), selon Equinix. « Ces GPU représentent déjà 10 % des processeurs dans nos data centers, mais bien plus de 10 % de notre consommation électrique. Et cette part va augmenter ». Les data centers représentent 2 % de la consommation mondiale d’électricité, soit un coût environnemental non négligeable. Outre l’électricité et l’empreinte carbone, les data centers dédiés à l’IA grignotent sur les sols et le foncier par le besoin de leur construction mais gaspillent également une quantité monstrueuse d’eau dans un contexte de tension mondiale renforcée par le changement climatique. Une conversation moyenne avec ChatGPT consomme approximativement 500 ml d’eau, des impacts considérables si l’on compte les 1,5 milliard d’utilisateurices mensuels. Les investissements dans cette nouvelle technologie sont en voie de dépasser ceux dans les énergies renouvelables. Ce nouvel outil du capitalisme, comme les actuels, trouve une fois de plus ses ressources dans la nature en exploitant les terres rares présentent dans les pays du Sud ou en Chine, dans le détournement de sources naturelles essentielles à la vie comme l’eau et le sol, ou encore renforcent les GES et donc le changement climatique. Il ré-ouvre également la question de l’énergie nucléaire.

Le travail n’est pas épargné par l’IA et l’impact négatif qu’elle peut avoir. La modernité, l’industrialisation et l’automatisme devaient révolutionner l’approche du travail en soulageant des tâches les plus lourdes et offrant plus de temps libre. Par effet domino, l’augmentation du temps libre pour la création, l’art, l’évolution des droits et de la société. Cela n’a pas eu l’effet escompté, à l’inverse, le travail s’est reporté sur d’autres emplois secondaires ou tertiaires, ainsi qu’un précarisation des emplois de sous-traitance. L’exploitation de la planète a aussi augmentée de façon disproportionnée. On voit dans les forces productives un instrument passif pour la production et l’expansion infinie du produit intérieur brut (PIB). Ce paradigme considère aussi bien la Terre que le travail comme des ressources nécessaires qu’il faut s’approprier et maintenir au coût le plus bas et le plus efficient possible [1] . Pour Stefania Barca [2], selon cette perspective, la crise écologique est considérée comme une conséquence des profondes inégalités créées par la modernité capitaliste/industrielle en assignant une valeur différenciée, de sorte que certains types de travail, de vie, de lieux et y compris d’espèces peuvent être sacrifiés sur les autels du bénéfice ou de la croissance du PIB. Considérée comme un succès indiscutable de l’humanité, la croissance économique est attribuée au génie blanc, masculin, européen, qui s’est traduit ainsi en suprématie planétaire. Cette pensée complète celle de Maria Mies [3] qui jeta les bases d’un écosocialisme féministe postcolonial, basé sur le rejet de la croissance du PIB comme mesure universelle de progrès. Pour elle, « la science et la technologie deviennent les principales ‘forces productives’, par lesquelles les hommes peuvent s'émanciper de la nature, ainsi que des femmes ».

L’avènement de l’IA rappelle ainsi l’essence des luttes écoféministe et socialiste au sens d’écosocialisme féministe. Il est bon de rappeler que la pensée écoféministe remet en cause une approche de la nature dominée par l'homme, par analogie avec la domination masculine sur les femmes. Cela conduit à condamner une vision de la gestion et de la protection qui serait celle des hommes blancs occidentaux. Catherine Larrère [4] cite des exemples d'approches féministes de la protection environnementale : plutôt qu'une mise sous cloche des milieux, ces approches préconisent une prise en compte des minorités dans la protection de la nature fondée sur l'éthique plutôt que sur des dispositifs techniques imposés verticalement. En ce sens, il s'agit d'une approche intersectionnelle des questions environnementales, décoloniales et économiques (décroissance). Dans la même veine, les femmes furent sous-humanisées et ont permis d’être la fourniture régulière de main-d’œuvre à bon marché pour soutenir l’industrialisation. [5]

Ce processus se reproduit avec l’IA. On parle beaucoup de la disparition des métiers de la culture comme cela a été incarné par la grève inédite des scénaristes et acteurices américain·es en 2023. Ces premières luttes restent pour autant des secteurs dominés par des hommes cis blancs avec un patrimoine culturel important. Cependant, le report de l’émergence de cette technologie va bel et bien se rabattre sur les plus vulnérables, c’est-à-dire les immigré·es, les femmes. On peut déjà s’interroger sur les transformations induites par le Digital Labor depuis quelques années et son l’accélération post-Covid19. En effet, on remarque que les personnes qui subissent des discriminations en raison de leur genre, de leur nationalité, de leur couleur de peau, de leur origine sociale ou de leur âge sont touchées de manière spécifique par ces transformations et la généralisation du Digital Labor [6]. Par exemple, les chauffeurs et des livreurs travaillant pour les plateformes, sont souvent des hommes issus de l’immigration, ces « travailleurs du clic » peuvent aussi être des femmes, et où les femmes précaires et/ou exclues du marché de l’emploi peuvent se tourner vers ces emplois facilement accessibles. Par ailleurs, la complexité générée par la mondialisation de ces emplois produit de nouvelles répartitions mondiales des tâches du travail numérique liées à l’IA. Alors que la plupart des sièges des grandes entreprises du web sont situées dans le Nord, l’immense majorité des « travailleuses et travailleurs du clic » nécessaires à l’apprentissage de l’IA générative sont employé·es par des sous-traitants dans les pays du Sud. Quant à la censure algorithmique, elles touchent plus les créatrices et créateurs de contenu minorisé·es (féministes, racisé·es, trans ou grosses, etc…) qui voient alors leur travail menacé.

Une fois de plus, il est démontré que les nouvelles technologies ou les progrès techniques reproduisent les modèles du patriarcat capitaliste. Pourtant, au lieu d’accentuer les oppressions des minorités ou la domination de la nature, ces avancées scientifiques devraient aider à lutter contre les inégalités et réduire le changement climatique. Il devient urgent que nos sociétés redonnent du sens à l’humanité sous peine d’allumer les révolutions à toutes les échelles.

[1] (Barca, 2020 ; Federici, 2009 ; Moore, 2015).

[2] Stefania Barca est chercheure au Centre d’études sociales de l’Université de Coimbra (Portugal), auteure de nombreux travaux sur l’écologie ouvrière et le syndicalisme.

[3] Maria Mies fut une professeure de sociologie, écrivaine et féministe allemande.

[4] Catherine Larrère est une philosophe française et une universitaire spécialiste de philosophe morale et politique.

[5] Silvia Federici (2004) Calibán y la bruja [Caliban et la sorcière].

[6] Eva Nada, sociologue, adjointe scientifique, Haute école de travail social, Genève, HES·SO

À voir

Another body de Sophie Compton et Reuben Hamlyn

Une étudiante américaine s’aperçoit que des vidéos porno la mettant en scène circulent sur les réseaux sociaux, alors qu’elle n’en a jamais tourné. Une enquête dans l’univers des deepfakes, ces images truquées grâce à l’intelligence artificielle, au potentiel toxique sans limite.

À lire

Data Feminism, Catherine D'Ignazio et Lauren F. Klein, The MIT Press, 2020

De Google Search aux applications de reconnaissance faciale, les algorithmes et les systèmes basés sur les données sont de plus en plus fréquemment accusés de (re)produire le racisme et le sexisme, contribuant à la prise de conscience du fait que, loin d’être des techniques neutres, ils représentent en réalité un enjeu de pouvoir majeur. Le livre Data Feminism propose d’aborder ce problème dans son ensemble, en se présentant comme un guide pour la pratique d’une science des données (data science) au service de la justice sociale, accessible à un large public.

La newsletter de Marie Dollé sur Substack

Cette « business analyst » rédige une lettre d'information en français et en anglais sur les tendances émergentes dans le domaine de la consommation et mène une réflexion sur l’IA. À retrouver ici.

À faire

Les Assises européennes du Journalisme de Bruxelles (20, 21 et 22 novembre 2024)

Cette 2ème édition est entièrement consacrée à l’IA avec plus de 80 intervenant·es sur 2 jours, rassemblant près de 30 pays différents (et une majorité de femmes !) pour questionner les pratiques journalistiques face à et avec l’IA. C’est gratuit, ouvert à tous·tes, en français et en anglais. Plus d’infos surwww.journalisme.com